Journal des citations pour l'incident 55

Entités

Voir toutes les entitésStatistiques d'incidents

Classifications de taxonomie CSETv1

Détails de la taxonomieHarm Distribution Basis

none

Sector of Deployment

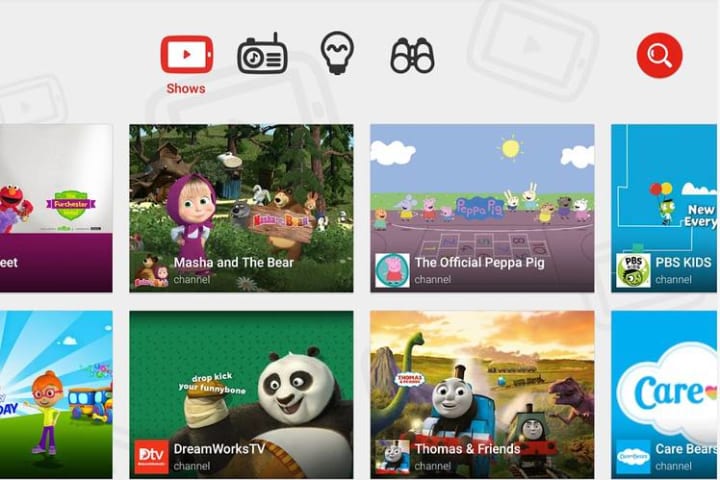

Arts, entertainment and recreation, information and communication

Classifications de taxonomie CSETv0

Détails de la taxonomieFull Description

An Amazon Echo Dot using the Amazon Alex software started to play pornographic results when a child asked it to play a song. The child said "Alexa, play Tigger Tigger" and Alexa responded with “You want to hear a station for porn detected...hot chick amateur girl sexy" and began to make other pornographic references until the parents turned off the Dot.

Short Description

An Amazon Echo Dot using the Amazon Alex software started to play pornographic results when a child asked it to play a song.

Severity

Negligible

AI System Description

The Amazon Alexa personal assistant listens to voice commands, and either provides information or takes action (e.g. playing a song, turning on lights).

System Developer

Amazon

Sector of Deployment

Information and communication

Relevant AI functions

Perception, Cognition, Action

AI Techniques

voice recognition, natural language processing

AI Applications

AI personal assistant

Named Entities

Amazon

Technology Purveyor

Amazon

Beginning Date

12-2016

Ending Date

12-2016

Near Miss

Unclear/unknown

Intent

Accident

Lives Lost

No

Data Inputs

Voice commands

Rapports d'incidents

Chronologie du rapport

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

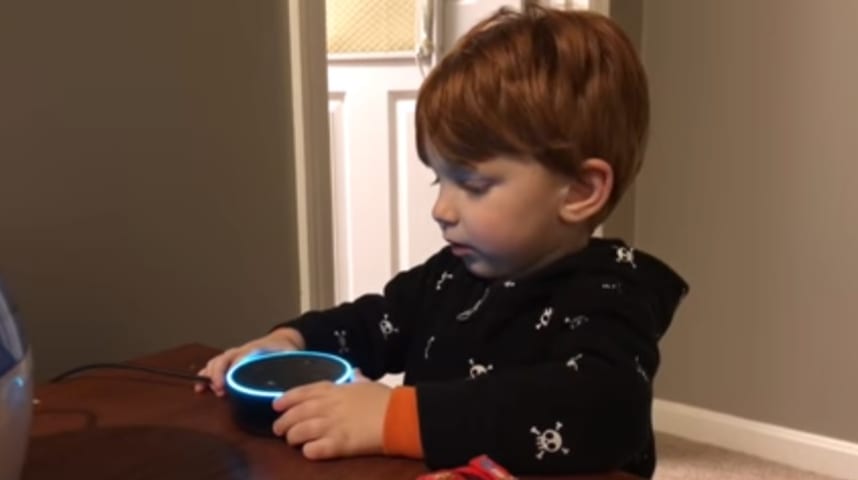

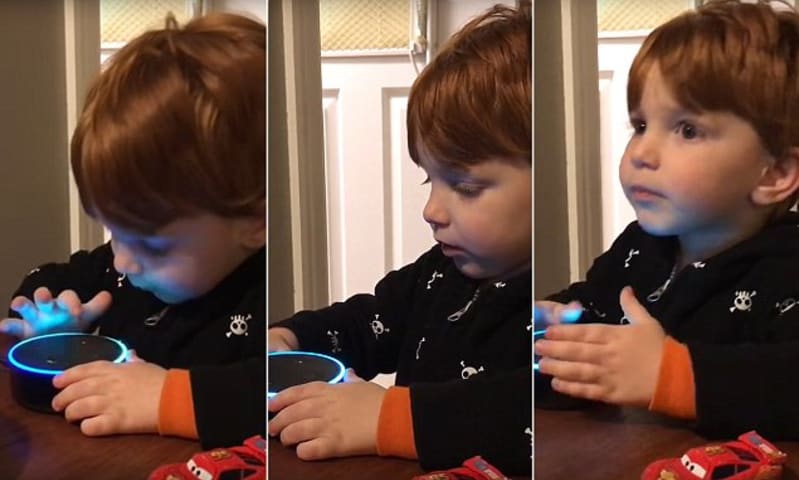

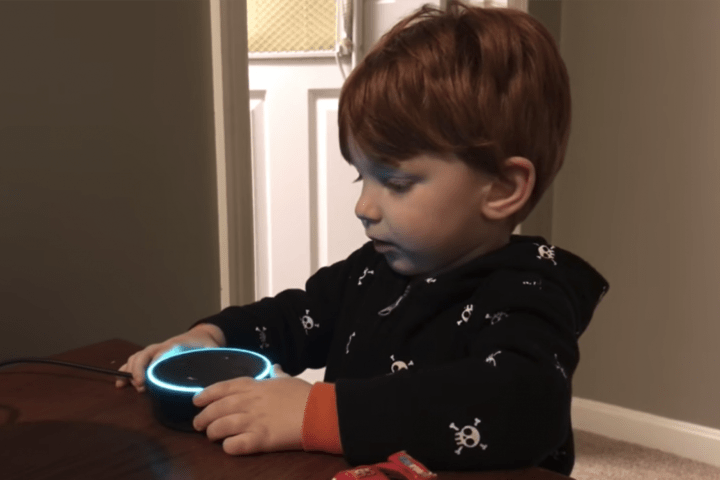

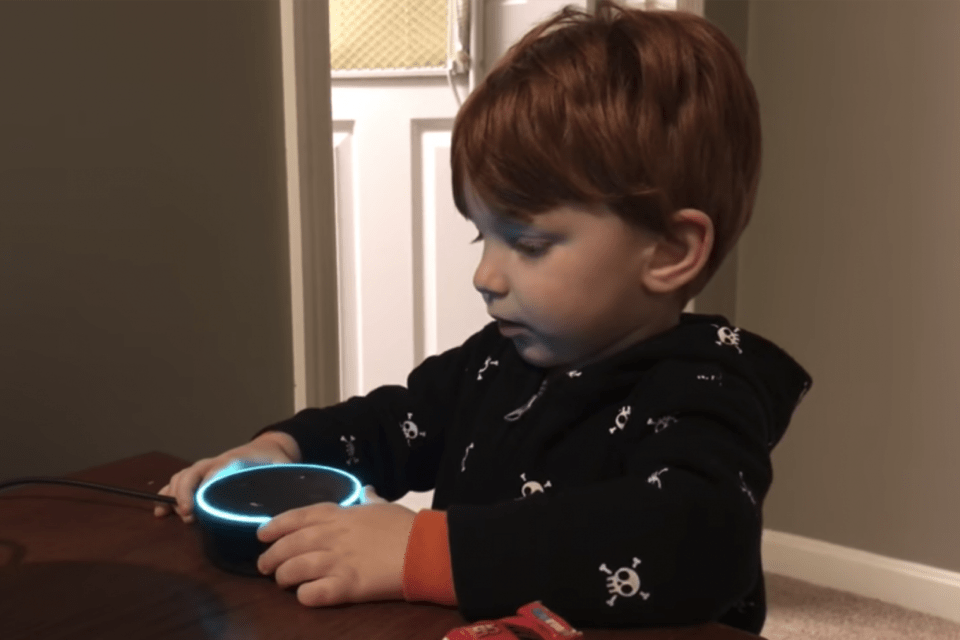

Après avoir ouvert un nouvel Amazon Echo Dot pour Noël, une famille a eu une… surprise intéressante lorsque leur enfant s'est glissé vers l'appareil pour lui demander de jouer une chanson en tenant le petit robot à deux mains et en criant d…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Amazon Alexa arrive sur une liste coquine avec NSFW Tirade devant un enfant

proche

Tout ce qu'il voulait, c'était entendre une chanson enfantine.

Une vidéo YouTube publiée le 29 décembre dernier est devenue virale avec 1,2 million de vues à…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Un petit garçon a obtenu plus que ce qu'il avait négocié lorsqu'il a demandé au nouvel Amazon Echo Dot de sa famille de lui jouer certaines des chansons préférées de son enfant.

Une vidéo hilarante sur YouTube montre un garçon nommé William…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Dans ce qui pourrait être une erreur innocente ou une mise en place par des adultes sages, l'assistante virtuelle d'Amazon, Alexa, a donné à un tout-petit une réponse très intéressante à sa demande d'entendre une chanson spécifique.

"Alexa,…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Une vidéo SHOCKING est apparue montrant Alexa d'Amazon bombardant un tout-petit avec des messages pornographiques grossiers.

Des images montrent un petit garçon parlant dans un gadget Amazon Echo Dot sous le regard des membres de la famille…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Un enfant demande à Amazon Alexa de jouer quelque chose, obtient du porno à la place Corey Chichizola Random Article Blend Il n'y a pas de meilleur moment que Noël pour les enfants. Gagner essentiellement à la loterie chaque année, c'est un…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Une famille a eu une mauvaise surprise lorsque leur petit garçon a demandé à l'assistant numérique d'Amazon "Alexa" de jouer certaines de ses chansons préférées, l'appareil proposant des suggestions de porno au lieu de morceaux.

La vidéo pu…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Dans cette vidéo NSFW, Amazon a mis le "X" dans Alexa lorsqu'un enfant lui a demandé de jouer sa chanson préférée. (Vous aurez envie de porter des écouteurs pour celui-ci, les amis.)

3 janvier 2017 1 min de lecture

La description de cette v…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Une vidéo publiée la semaine dernière par l'utilisateur de YouTube "F0t0b0y" a été visionnée plus de 7 millions de fois montrant un tout-petit demandant une chanson à un appareil Amazon uniquement pour obtenir une réponse torride de l'appar…

![Qu'est-ce que l'enfant dans la vidéo Alexa demande à entendre avant qu'Alexa ne se déchaîne ? [VIDÉO]](https://res.cloudinary.com/pai/image/upload/f_auto/q_auto/c_fill,h_480/v1/reports/townsquare.media/site/71/files/2017/01/Screen-Shot-2017-01-03-at-4.27.59-PM.png?w=600&h=0&zc=1&s=0&a=t&q=89)

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Si vous n'avez pas vu la vidéo la plus drôle du mois dernier, vous devez vivre sous un rocher. Cette vidéo montre un petit enfant demandant à Alexa de jouer une chanson, et Alexa devient voyou et commence à faire des suggestions très NSFW à…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

ActualitésPornographie

SEATTLE, Washington, 6 janvier 2017 (LifeSiteNews) - Amazon's Echo Dot est un petit appareil à commande vocale qui répond aux questions, joue de la musique et des sons, et fonctionne essentiellement comme une encyclop…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Alors vous pensiez que l'IA est cool ? Alors vous pensiez qu'Alexa pourrait veiller sur votre enfant ? Attendez que l'IA commence à cracher des gros mots et à acheter des jouets coûteux pour votre enfant.

Le CES 2017 a été une vague de tech…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Amazon Echo est apparemment toujours prêt, toujours à l'écoute et toujours plus intelligent. Ainsi va le discours sur l'élégant haut-parleur noir à commande vocale, le produit le plus vendu d'Amazon à Noël, avec des millions maintenant vend…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Nous ne pouvons pas éloigner nos enfants de nos gadgets, et le nouvel Amazon Echo, le produit le plus vendu du géant de la vente au détail en ligne à Noël, ne fait pas exception.

Si vous ne le savez pas déjà, Amazon Echo - maintenant dans d…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Partager

Parmi la myriade de descriptions prélevées sur le système de "maison intelligente" Alexa d'Amazon, ses créateurs ne s'attendaient probablement pas à l'expression "cauchemar parental". Pourtant, cette description est revenue à maint…

- Afficher le rapport d'origine à sa source

- Voir le rapport sur l'Archive d'Internet

Luke est le rédacteur en chef adjoint de Verdict. Vous pouvez le joindre à luke.christou@verdict.co.uk

Les assistants virtuels, tels qu'Amazon Alexa et Siri d'Apple, sont censés faciliter légèrement nos vies occupées.

Plutôt que de perdre d…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

![Qu'est-ce que l'enfant dans la vidéo Alexa demande à entendre avant qu'Alexa ne se déchaîne ? [VIDÉO]](https://res.cloudinary.com/pai/image/upload/f_auto/q_auto/c_fill,h_640/v1/reports/townsquare.media/site/71/files/2017/01/Screen-Shot-2017-01-03-at-4.27.59-PM.png?w=600&h=0&zc=1&s=0&a=t&q=89)